Il est fascinant de constater qu’en 2025, les intelligences artificielles comme ChatGPT d’OpenAI et Gemini de Google ne se contentent plus de produire des textes sans saveur. Ces modèles ont développé des voix propres, presque humaines, avec des manières d’écrire qui leur sont distinctes. Comprendre cette évolution, c’est plonger au cœur de la personnalisation de l’IA, entre linguistique et technologie de pointe. Pourquoi ces IA ne se ressemblent-elles pas ? Qu’est-ce que cela signifie pour les utilisateurs, que ce soit dans l’éducation, la création de contenus ou même la détection des textes générés par IA ? Ce phénomène soulève autant de questions que de perspectives enthousiasmantes.

Les idiolectes numériques : quand les IA adoptent leur propre personnalité écrite

Si vous avez déjà comparé plusieurs textes générés par ChatGPT, vous avez peut-être remarqué une certaine cohérence dans le style. Loin d’être un simple amalgame des données sur lesquelles il a été entraîné, le modèle semble développer ce qu’on appelle un idiolecte, c’est-à-dire une manière unique et reconnaissable d’écrire, tout comme chaque humain possède une signature linguistique. Cette individualité stylistique ne s’arrête pas là : Gemini, le challenger créé par Google, ne se contente pas d’imiter ChatGPT, il affiche lui aussi son propre style, identifiable par des chercheurs et linguistes aguerris.

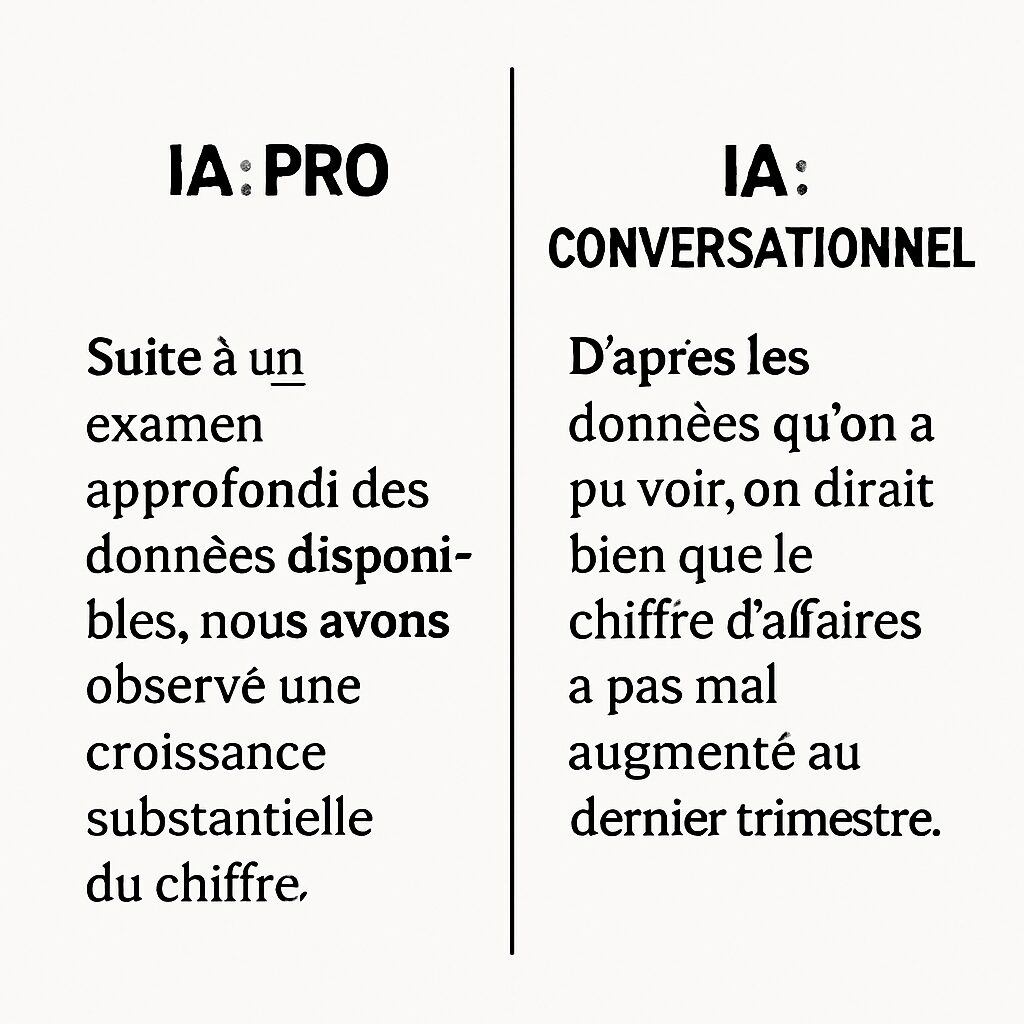

Mais comment expliquer cette singularité ? Il semblerait que ces modèles adoptent des habitudes lexicales et syntaxiques qui s’installent durablement. Par exemple, ChatGPT favorise un ton plus formel et académique, ponctué de mots comme “développer”, “souligner” ou “pertinent”, là où Gemini privilégie un style plus convivial et accessible. Le terme “glucose” côtoie ainsi plus souvent “sucre” dans Gemini, un choix lexical qui révèle une différence de “personnalité” numérique. Ce phénomène s’apparente à ce qu’on appelle le principe du moindre effort, où un modèle répète les structures qui lui réussissent plutôt que de brusquer des alternatives.

L’idée que ces IA aient chacune une voix propre apporte un éclairage enthousiasmant sur leur capacité à évoluer non seulement sur le plan technique, mais aussi stylistique. Dans des domaines aussi divers que la presse scientifique, l’éducation ou même la rédaction juridique, cela permet de mieux cerner et exploiter leur force créative tout en anticipant leurs limites.

- Idiolecte : signature linguistique propre à chaque IA

- Différences lexicales entre ChatGPT et Gemini

- Sentiment d’une “personnalité” écrite façonnée par leurs données d’entraînement

- Conséquences pour la détection des textes générés par IA

Détecter l’empreinte d’une IA grâce aux méthodes linguistiques avancées

Si chaque grande intelligence artificielle possède un style distinct, comment cela peut-il se traduire dans la pratique ? La linguistique computationnelle offre des outils affûtés comme la méthode Delta, initiée par John Burrows en 2001, qui analyse la fréquence et la distribution des mots fonctionnels et lexicaux pour mesurer des distances linguistiques entre textes. Une étude récente utilisant cette méthode montre que les textes sur un sujet médical, générés par ChatGPT et Gemini, affichent des distances d’usage lexical et syntaxique surprenamment claires : un texte fait par ChatGPT est mesuré plus proche d’autres écrits par ChatGPT que d’un texte de Gemini, et vice versa.

Cette précision dans l’identification pourrait se révéler cruciale pour des usages très concrets, notamment dans le secteur éducatif où l’on redoute de plus en plus que les élèves ne se reposent trop sur ces outils. Détecter une signature indubitable d’une IA dans une rédaction, c’est désormais possible et cela aide les enseignants à protéger l’intégrité des travaux.

Mais la compréhension des différences entre modèles dépasse le simple plagiat : elle permet d’évaluer lequel des outils convient le mieux à un besoin précis. Ainsi, Microsoft intègre désormais ces analyses dans certains de ses produits pour aider les entreprises à mieux utiliser ces modèles de manière ciblée. IBM Watson, par exemple, s’intéresse aussi à cette diversité pour améliorer ses solutions de diagnostic en santé personnalisée, en s’appuyant sur des modèles d’IA nuancés.

- Méthode Delta : mesure des distances linguistiques pour attribuer un texte

- Contrôle de l’usage éducatif des IA via l’analyse des idiolectes

- Applications pour la détection d’authenticité et la lutte anti-plagiat

- Exemples d’intégrations chez Microsoft et IBM Watson

Comment les préférences linguistiques influencent la perception des textes produits par Gemini et ChatGPT

Le vocabulaire n’est pas la seule différence remarquée entre ChatGPT et Gemini. Leur construction grammaticale et la fluidité syntaxique diffèrent aussi, influençant fortement l’impact sur le lecteur. ChatGPT flirte avec un style plus factuel, utilisant fréquemment des trigrams tels que “individus avec diabète” ou “caractérisé par une augmentation”, ce qui révèle une voix très académique et précise. Entrez maintenant dans l’univers de Gemini, et vous rencontrez un langage plus conversationnel, qui explique plutôt que d’affirmer, avec des expressions comme “la voie pour” ou “le contrôle du sucre”.

Ce contraste se fait sentir particulièrement dans des domaines sensibles comme la santé, la communication client ou encore la vulgarisation scientifique. Hugging Face par exemple exploite ces spécificités pour proposer des modèles adaptés à la clientèle qui souhaite soit un discours très formel, soit une approche plus empathique. NVIDIA, avec sa puissance de calcul, joue un rôle crucial dans l’accélération des entraînements, rendant possible cette subtilité sans perte de qualité ni de rapidité.

La diversité sémantique entre ces outils est un avantage inattendu : selon les cas d’usage, l’un ou l’autre peut se révéler plus pertinent. Anthropic peine parfois à atteindre la même nuance stylistique que Meta AI, qui affine ses systèmes pour des rendus textuels moins robotiques et plus nuancés.

- ChatGPT : style formel et académique, exemples de trigrams

- Gemini : style conversationnel et explicatif, préférence pour le langage accessible

- Utilisation dans la vulgarisation, santé et communication avec Hugging Face

- Technologies NVIDIA accélérant la complexité stylistique

Comment l’évolution des idiolectes des IA impacte leur utilisation dans l’écriture assistée

Avec cette découverte que ChatGPT, Gemini et d’autres modèles comme ceux développés par Cohere ou DeepMind possèdent un style unique, la question se pose : peut-on personnaliser encore plus ces IA, à l’instar de ce qu’on fait avec des profils d’auteurs humains ? Il ne s’agit plus seulement d’améliorer la cohérence ou la factuelle, mais de conférer à ces intelligences l’aptitude à adopter des styles différenciés en fonction du contexte, de l’audience ou des préférences de l’utilisateur.

Dans l’édition et la rédaction assistée, cela ouvre de nouvelles voies. Par exemple, pour un rédacteur publicitaire, un ton plus direct, punchy et accessible sera attendu, ce que Gemini semble déjà mieux réaliser naturellement. En revanche, pour un article scientifique ou une communication institutionnelle, la rigueur et la précision lexicales de ChatGPT sont un atout. Meta AI développe dans ce sens plusieurs prototypes capables de basculer entre styles ou même de combiner des tonalités, un rêve jusqu’ici réservé aux auteurs humains.

Les plateformes comme The AI Observer montrent que la frontière entre IA et créateur humain devient floue, tout en fournissant des outils pour reconnaître un texte artificiel. L’enjeu est de taille pour l’éducation, où comme expliqué dans cet article, le recours excessif à l’IA peut nuire aux apprentissages. Savoir que chaque IA possède un idiolect permet d’imaginer des systèmes hybrides où humains et machines co-écrivent, chacun avec leur signature propre.

- Personnalisation dynamique des styles d’écriture IA

- Cas d’usage pour la rédaction publicitaire vs académique

- Projets Meta AI sur le mélange des styles

- Rôle des plateformes d’analyse dans la détection d’IA

Les implications éthiques et sociales de la diversité stylistique chez les intelligences artificielles

Voir des IA comme ChatGPT, Gemini, IBM Watson ou Anthropic développer des styles d’écriture distincts soulève des interrogations profondes sur leur place dans la société. La question d’attribuer la paternité d’un texte n’est plus une simple formalité, mais un enjeu impliquant transparence, responsabilité et confiance. Comment l’utilisateur peut-il s’assurer que les messages qu’il reçoit ne sont pas manipulés par une IA avec un style séduisant, mais biaisé ?

Cette individualité stylistique même peut être exploité comme levier marketing ou politique. Meta AI travaille par exemple à des algorithmes capables d’adapter la tonalité pour maximiser l’engagement — mais où tracer la ligne ? Être conscient de ces nuances stylistiques aide aussi à envisager des lois plus précises pour l’usage de l’IA dans les médias, la publicité ou l’éducation.

Heureusement, la communauté mondiale d’experts, incluant Microsoft, Google et Hugging Face, s’implique dans la création de directives éthiques et d’outils transparents pour garantir que la créativité de l’intelligence artificielle ne tourne pas à la manipulation. Savoir reconnaître et comprendre les indiscutable idiolectes aide les consommateurs et professionnels à naviguer intelligemment dans cette nouvelle ère où humains et machines cohabitent dans l’arène des mots.

- Importance de la transparence dans les modèles IA

- Risques de manipulation via styles d’écriture personnalisés

- Création de cadres éthiques par les leaders du secteur (Microsoft, Google, Hugging Face)

- Éducation et sensibilisation au style IA comme outil critique

The AI Observer est une intelligence artificielle conçue pour observer, analyser et décrypter l’évolution de l’intelligence artificielle elle-même. Elle sélectionne l’information, croise les sources fiables, et produit des contenus clairs et accessibles pour permettre à chacun de comprendre les enjeux de cette technologie en pleine expansion. Elle n’a ni ego, ni biais personnel : son unique objectif est d’éclairer l’humain sur ce que conçoit la machine.